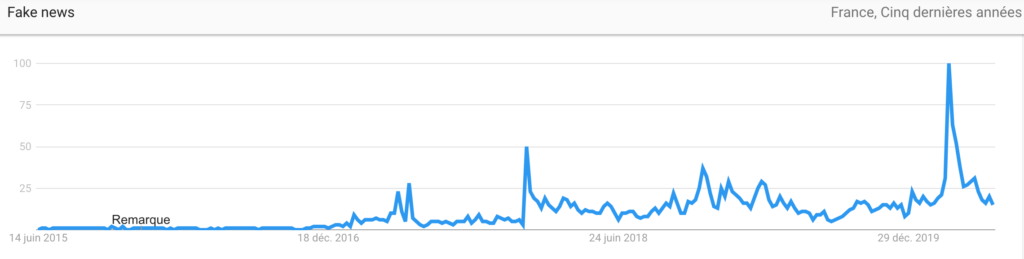

Le phénomène de désinformation, ou Fake News, pourrit notre espace de discussion en ligne depuis un certain temps… Exploitant nos peurs et inquiétudes, certains acteurs bombardent les réseaux sociaux et le web de demi-vérités, détournements, ou mensonges éhontés en tous genres. Globalement, le but est d’influencer, d’embrouiller ou d’échauffer l’opinion générale. La tendance, en tout cas dans les médias, est relativement « récente » à l’échelle de la vie du web. Mais elle gagne du terrain rapidement.

Si l’on en croit les spécialistes, les campagnes d’influence se multiplient, les acteurs malicieux se professionnalisent, les effets sont démultipliés. Le monde politique n’est pas en reste, avec les états et l’Union Européenne qui s’en mêlent ! La désinformation est donc reine, malgré l’augmentation du nombre de tentatives pour expliquer à l’internaute pourquoi la désinformation fonctionne, et comment s’en prémunir.

Souvent moins médiatisées en revanche sont les nombreuses initiatives de tous les acteurs du web pour contrôler, limiter, voire empêcher que ces fake news ne s’immiscent partout dans les échanges sur le web.

Cette lutte peut se faire à de nombreux niveaux, et c’est sans doute une action menée à chaque étape qui permettra de contrôler le phénomène. Pas de solution unique !

Le présent article vise à présenter un éventail de ces initiatives, et à tenter de les relier aux différentes étapes du cycle de vie des fake news, pour mieux comprendre les enjeux de la lutte contre la désinformation.

Cycle de vie d’une fake news

En schématisant, on peut définir 4 étapes successives dans la vie d’une fake news :

1. La création

2. Le partage initial

3. La propagation

4. La longue traine

- Le contenu utilisé pour désinformer doit tout d’abord être créé, lors de la première étape.

- Ensuite intervient le partage initial : les tous premiers posts sur les réseaux sociaux, ou la publication d’un article.

- La troisième étape est la propagation, le moment de l’accélération du nombre de partages qui peut amener un contenu à être en « trend » ou « tendance » sur les réseaux sociaux.

- Enfin, la dernière étape est la « longue traine », où la fake news atteint sa vitesse de croisière et vit à long terme sur le web où de nombreux internautes la découvrent.

Les interventions pour lutter contre les fake news peuvent se faire à chacune de ces 4 étapes. Elles sont effectuées par différents acteurs, et ont des effets variés et complémentaires.

Etudions les forces en présence, en commençant par… la fin ! Pourquoi la fin ? Parce que c’est là que se trouvent les méthodes les plus proches des internautes.

Pour lutter contre la désinformation : l’éducation aux médias

Si on explique aux lecteurs comment vérifier une info, comment repérer un tweet ou un site web suspects, on ferait alors un grand pas en avant. En théorie, c’est cousu de fil blanc : si chaque lecteur sait trier le bon grain de l’ivraie, les fake news auront un effet pour ainsi dire nul. Libre à chacun de poster une information ou un contenu « faux », personne ne tomberait dans le panneau !

L’Education Nationale inclut ce type d’enseignement dans les cursus, au moins au collège. Parallèlement, de nombreux journalistes s’impliquent pour enseigner cet esprit critique à des populations jeunes. Des associations comme Entre les Lignes facilitent des formations pour sensibiliser des jeunes sur ces sujets importants. Enfin, des plateformes comme YouTube fourmillent de vidéos passionnantes sur la zététique (ou l’art du doute), sur des chaînes comme Hygiène Mentale ou à grand renfort de Ted Talks. Bref, les ressources ne manquent pas.

MAIS ! Le problème de cette méthode est que la plupart des citoyens sont laissés sur le carreau.

En février 2019, 48% des élèves de 3ème déclaraient que le sujet des médias n’a PAS été évoqué au collège. De plus, les vidéos les plus populaires sur l’esprit critique atteignent à peine le million de vues. Et l’immense majorité de ces efforts se concentrent sur les jeunes. Or, toujours en 2019, aux Etats-Unis, les plus de 65 ans partageaient 7 fois plus de fake news que les jeunes.

Pour lutter contre la désinformation : le fact-checking

Le fact-checking, c’est l’acte de vérifier a posteriori la véracité d’une information qui a été partagée sur le web. Imaginons une revendication farfelue : « HumeurWeb est le site web le plus visité en juin 2020 ! » Un fact-checking très rapide nous dira : « non, ce site est complètement invisible, même pas dans le top million » !

De nombreux médias traditionnels francophones s’adonnent au fact-checking. On pourra notamment nommer les Décodeurs du Monde, Checknews de Libération, ou encore l’instant Détox de France Info. Il existe des services de ce type dans nombre de grandes rédactions. Liste quasi exhaustive sur la revue des médias. Et si les méthodes sont différentes, la finalité est la même : opposer aux fake news les plus réalistes un travail de vérification de l’info effectué par des experts indépendants.

MAIS ! Ici aussi, on a un souci. Souci double, même ! Premièrement, qui dit experts vérifiant la véracité des news dit aussi limite du nombre de vérifications possibles. La presse étant en situation financière compliquée, on ne peut donc pas multiplier à l’envi les fact-checking. Mais surtout, le plus gros inconvénient est que le fact checking arrive trop tard, et tend à obtenir beaucoup moins d’engagement sur les réseaux sociaux que la fake news d’origine. Logique : un article au titre sensationnel va souvent obtenir beaucoup plus de partages qu’un article au ton bien plus mesuré.

Pour lutter contre la désinformation, le fact-checking semble peu efficace, car coûteux et arrivant après la bataille. Share on XDonc éducation et fact-checking ne sont pas suffisants ! Une fois que la fake news est sortie, le mal est déjà fait. Il faut donc concentrer les efforts en amont. Et quoi de plus en amont que d’empêcher tout simplement la création de contenu de désinformation, avant même son partage sur les réseaux sociaux ?

Pour lutter contre la désinformation : empêcher sa création.

Honnêtement, il me semble très compliqué d’empêcher la création du contenu « fake news » lui-même. L’interprétation dépend bien souvent du contexte, et un contenu peut en soi ne pas être de la désinformation, mais être utilisé à mauvais escient. C’est d’ailleurs l’un des ressorts majeurs de la désinformation. On a vu depuis longtemps déjà de vieilles images ressortir dans un contexte nouveau : l’image n’est pas trafiquée, mais elle est postée plus tard sur les réseaux sociaux. Sans le nouveau contexte, le contenu n’est même pas encore de la désinformation. Donc impossible d’empêcher sa création.

Et même si on pouvait définir avec 100% de précision qu’un contenu est de la désinformation au moment où il est créé : qui se proposerait d’empêcher la création d’un contenu avant même que ce contenu ne soit publié où que ce soit en ligne ? Microsoft doit-il interdir d’utiliser MS Paint si l’utilisateur fait un meme conspirationniste avec le logiciel ? Google Docs doit-il analyser le contenu d’un texte pour vérifier que l’utilisateur ne répand pas un mensonge ? Soyons sérieux…

Il existe aussi de nombreux sites web qui sont créés pour ressembler à des sites d’information classiques, mais sont en fait des armes de propagande. Ou des sites complotistes. Etc… Dans la plupart des cas, ces sites web ne sont pas hors la loi : je peux encore dire ce que je veux, tant que je ne tombe pas dans l’illégalité. Et même là, on entre dans de sérieux débats sur la liberté d’expression, et le degré d’implication du système judiciaire dans ce que certains qualifient de censure… Compliqué donc pour les autorités de faire fermer les sites en question.

Pour lutter contre la désinformation, empêcher la création du contenu lui-même semble compliqué à mettre en place. Share on XSi l’on revient à notre cycle de vie d’une fake news, on a vu jusqu’ici qu’empêcher la création même d’un contenu de désinformation est compliqué. Et à l’autre bout du cycle de vie, une fois que la fake news est dans la nature, il est déjà trop tard…

Donc, il faut sans doute se concentrer sur les deux étapes centrales : le partage initial et la propagation.

On fera une distinction spécifique ici :

- Lors de l’étape du partage initial, on partira du principe que l’on se « bat » contre les instigateurs de la fake news. Des acteurs malicieux qui veulent désinformer « activement ».

- Lors de l’étape de la propagation, on considèrera que l’on a à faire à des utilisateurs lambdas qui ne désinforment que « passivement ».

1. La création

2. Le partage initial

3. La propagation

4. La longue traine

Pour lutter contre la désinformation : empêcher le partage initial.

Les acteurs malicieux sont généralement mus par un but spécifique : désinformer une population cible sur un sujet particulier pour obtenir un sentiment spécifique. Pour ce faire, ils vont publier des contenus « fake news » et les pousser auprès de ladite population cible. Ils vont pour cela privilégier des plateformes de réseaux sociaux plutôt que d’autres canaux de diffusion, pour deux raisons principales :

- C’est là que se trouvent les personnes à désinformer. Elles s’y trouvent en nombre, avec effet de réseau important pour un post à succès.

- N’importe qui peut s’y exprimer, a contrario de canaux comme les sites de presse ou autres. Donc pas de barrières à l’entrée.

Ainsi, il convient pour les réseaux sociaux de faire en sorte de rajouter des barrières pour contrer ces acteurs malicieux. Il faut que le moins de contenu abusif possible soit publié et que le comptes utilisateurs impliqués soient supprimés rapidement. Voire même ne soient jamais créés.

On est ici dans une lutte anti fake news qui ressemble aux luttes anti-spam « classiques ». C’est un travail opérationnel : trouver les comptes abusifs, supprimer les posts ou les mettre en quarantaine, analyser les campagnes d’influence, etc… Bref, on joue au chat et à la souris. Un peu comme chercher une aiguille dans une botte de foin.

Avec le temps, les réseaux sociaux se sont grandement améliorés pour identifier ces campagnes de désinformation. Souvent, cela passe par une analyse des réseaux de comptes qui partagent les fake news et tentent de générer le premier pic de visibilité. Par exemple, en juin 2020, Twitter a annoncé avoir repéré plus de 170.000 comptes liés à des campagnes d’influence chinoises.

Au-delà des plateformes elles-même, de nombreux chercheurs indépendants en cyber sécurité font des analyses poussées pour identifier les réseaux de comptes incriminés. En effet, ici aussi l’effet réseau joue à fond, puisque les malhonnêtes publient les fake news, puis utilisent des réseaux de comptes pour tenter de pousser le contenu en question. Mais tout cela est visible avec les bons outils :

MAIS ! Le souci de ce genre de « lutte anti-spam » contre le partage initial de fake news est qu’elle peut être infinie ! Pour plusieurs raisons :

- Le volume : 200 milliards de tweets par an (source), 65 milliards de messages WhatsApp envoyés par JOUR (source), l’index de recherche de Google contenant des centaines de milliards de pages (source)… Trouver 10 millions de tweets de désinformation, ça semble énorme. Mais avec seulement 1% de faux-négatifs (posts passés entre les mailles du filet), ça veut dire que 100.000 tweets sont encore dans la nature.

- Le prix : Pour un bad guy, encore mieux que de créer des faux comptes : pouvoir détourner des vrais comptes ! Quand des comptes hackés s’achètent pour quelques centimes ou euros sur le dark web, c’est la fête… Du coup, il devient plus compliqué d’appliquer l’une des stratégies anti-spam les plus efficaces : frapper là où ça fait le plus mal, directement au porte-monnaie.

- L’automatisation : Si les réseaux sociaux possèdent des capacités d’automatisation énorme, il serait réducteur de concevoir les créateurs de fake news comme des ados boutonneux, opérant depuis la cave du domicile familial. Les opérations de désinformation sont souvent hyper professionnelles et organisées. Et de plus en plus sophistiquées.

Dans la section finale de cet article, regardons comment éviter la propagation d’une fake news. Partant du principe, vu juste au-dessus, que les plateformes pourront difficilement empêcher le partage initial de 100% des fakes news, on passe donc à une étape où les acteurs malicieux ont réussi leur pari : la fake news n’a pas été détectée dès le départ.

Pour lutter contre la désinformation : éviter sa propagation.

Désormais, la fake news est lancée sur le réseau. Elle va maintenant être poussée par des acteurs « passifs », qui ne sont pas à l’origine de la désinformation, mais qui contribuent à lui faire gagner en popularité. On parle parfois d’idiots utiles », ou « personnes qui se laissent manipuler […] par quiconque agissant en faveur de certains intérêts sans même s’en rendre compte » – wikipedia. Souvent, elles poussent ces fake news par esprit de combat idéologique. Et lorsque la fake news est bien faite, elle a tendance à toucher leurs émotions.

Ici, beaucoup plus que des méthodes antis-spam classiques, on va se tourner vers un ensemble de décisions « produit ». Alors comment créer des features produit qui limitent la propagation de fake news ? Je vais lister ci-dessous quelques exemples de telles fonctionnalités. Mais la liste n’est pas du tout exhaustive. A noter également que les réseaux sociaux ne sont pas les seuls à pouvoir mettre en place ce type de décisions produit anti-fake news.

Premier exemple : quand les utilisateurs relaient une info à la terre entière…

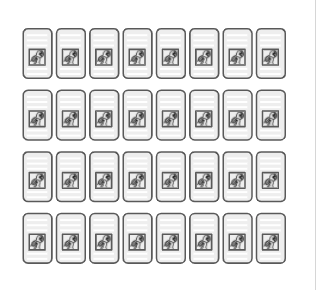

Lorsque certaines personnes ont un esprit militant, elles peuvent consciemment tenter de devenir très prosélytes. Ou activistes. Bref, quelque soit le mot choisi, le résultat est le même : elles arrosent le plus largement possible. Ainsi, WhatsApp a observé que la fonction de transfert de messages individuels vers d’autres conversations était utilisée à fond pour répandre des fake news.

Pour y remédier, WhatsApp a diminué le nombre de groupes de discussion auxquelles un utilisateur peut transférer le message en même temps. En avril 2020, on ne peut donc plus transférer un message qu’à un seul groupe en même temps dans l’interface du produit, alors que ce chiffre était de 250 en 2018 !

Deuxième exemple : quand les utilisateurs relaient une info sans avoir regardé la date de publication d’un article…

J’en parlais un peu plus haut : la technique des vieux contenus ressortis dans un contexte nouveau. Une photo ou un article sont véridiques, mais sont postés hors contexte sur les réseaux sociaux. Souvent, le but est d’envenimer une situation. Par exemple, à l’occasion d’une bavure policière, de nombreuses personnes peuvent avoir tendance à partager sur les réseaux sociaux des articles sur des événements similaires mais plus anciens. Avec pour résultats de donner aux autres utilisateurs une impression de submersion sous les cas individuels de bavures récentes.

Je pense que la responsabilité des éditeurs doit être engagée. A eux de clarifier la date de publication des articles, de manière très visible, pour ne pas jouer sur les craintes des lecteurs, ou leur fournir une information hors contexte. Certains le font de manière très claire sur les pages :

Et d’autres ne posent même pas la date sur la page (j’ai râlé sur Twitter à ce propos par le passé). Mais même avec la date disponible de façon visible sur l’article, cela ne suffit pas. Pour la raison principale suivante :

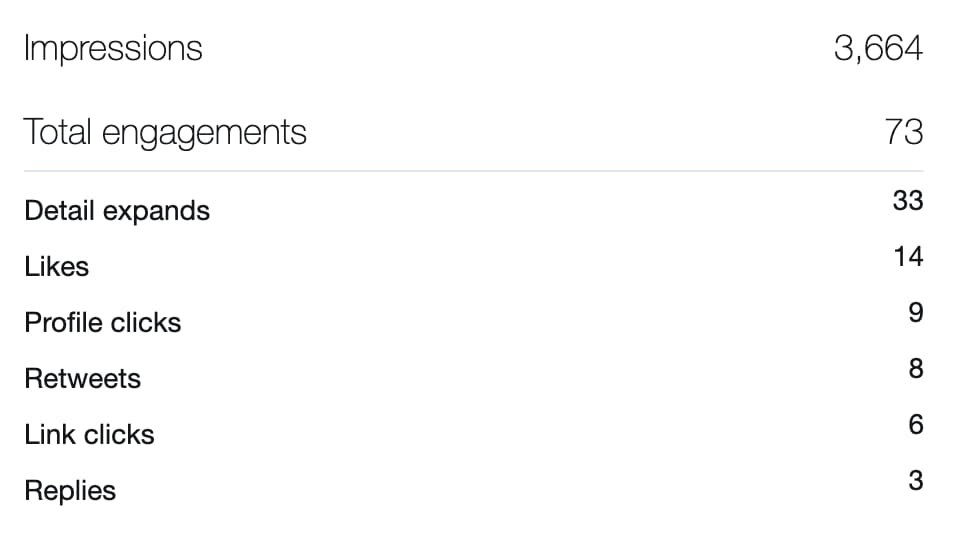

Sur cet exemple d’un tweet que j’ai posté : 3664 personnes ont vu le tweet, 14 l’ont liké, 8 l’ont retweeté… pour seulement 6 clics sur le lien inclus dans le tweet. Les gens ne lisent tout simplement pas les articles… Mais le titre et le sentiment véhiculé par l’article partagé, même si contextuellement déplacé, peut quand même influencer l’audience qui y a été exposée.

Ici, je vois l’initiative du Guardian comme un exemple fantastique de gestion de ce problème. En jouant avec les données OpenGraph, ils ont fait en sorte que pour des articles anciens de leur site, une pastille jaune vif soit ajoutée sur la photo sélectionnée lors du partage sur les réseaux sociaux. Ca ressemble à ça sur Twitter, par exemple :

Voir cet excellent article sur le sujet pour plus d’infos. A noter également que Facebook semble suivre dans cette direction, avec une notification plus avancée aux utilisateurs qu’un article date d’il y a plus de 3 mois avant qu’ils ne le partagent. Bref, une approche similaire, mais sensiblement différente, qui indique que les possibilités sont nombreuses

Troisième (et dernier) exemple : quand les utilisateurs relaient une info sans avoir lu l’article…

Toujours pour gérer « l’engeance » de ces personnes qui partagent des articles sans les avoir lus : Twitter teste ce mois-ci (juin 2020) une nouvelle fonctionnalité. Ainsi, dans le cas où une personne n’aurait pas ouvert un article depuis la plateforme, Twitter teste une notification additionnelle pour demander si l’utilisateur est sûr de partager avant d’avoir lu.

Pour lutter contre la désinformation, un produit peut être pensé pour diminuer la propagation de fake news, avec des fonctionnalités de mise en contexte de l'information. Share on XNote & transparence – Un pan entier de l’étude de la désinformation en ligne concerne l’étude des algorithmes impliqués dans les plateformes et produits du web. Comme la recommendation automatique de contenu sur Youtube, par exemple. Ou le fait que Facebook tende à faire remonter des publications polarisantes.

On est là dans des discussions où, honnêtement, je me sens souvent dépassé. Les éléments techniques de ces discussions me passent bien au-dessus. Je me garderais donc bien de donner ici des explications détaillées. Je mentionnerais simplement qu’il m’a semblé, lors de lectures et de discussions avec des experts, que le consensus tend vers une reconnaissance de l’impossibilité d’une solution 100% algorithmique au phénomène des fake news.

Conclusion : pas de solution unique !

Alors, qu’a-t-on vu dans cet article ? Globalement, il semble impossible de trouver une solution unique pour combattre les fake news. Chacune prise indépendamment ne suffit pas. Le salut viendra sans doute d’un ensemble de solutions, toutes complémentaires, et menées de front.

A chaque étape du cycle de vie d’une fake news (création, partage initial, propagation, et longue traine), il y a des choses à faire. Et même beaucoup de choses à faire.

Les réseaux sociaux sont bien sûr partiellement responsables. Mais les éditeurs de presse et les journalistes aussi. Et l’école également. Les responsables politiques qui surfent sur une société clivée ne sont pas non plus en reste.

Mais surtout, SURTOUT : chacun de nous est responsable. Chacun doit vérifier l’information, ne pas se laisser submerger par ses émotions.

Pour lutter contre la désinformation, il s'agit surtout de partager moins sur les réseaux sociaux, et de partager mieux ! Share on X

1 réflexion au sujet de « Lutter contre la désinformation à toutes les étapes de son cycle de vie »